- La génération de texte vers image

- L’édition d’image vers image

- La composition multi-image

- L’enregistrement des images générées

- URL de base :

https://api.cometapi.com - Installez le SDK :

pip install google-genai(Python) ounpm install @google/genai(Node.js)

Configuration

Initialisez le client avec l’URL de base de CometAPI :Génération de texte en image

Générez une image à partir d’un prompt textuel et enregistrez-la dans un fichier.candidates[0].content.parts, qui peut contenir des parties de texte et/ou d’image :

Génération Image-to-Image

Téléchargez une image d’entrée et transformez-la avec un prompt textuel.- Le SDK Python accepte directement les objets

PIL.Image— aucun encodage Base64 manuel n’est nécessaire. - N’incluez pas le préfixe

data:image/jpeg;base64,lors du passage de chaînes Base64 brutes.

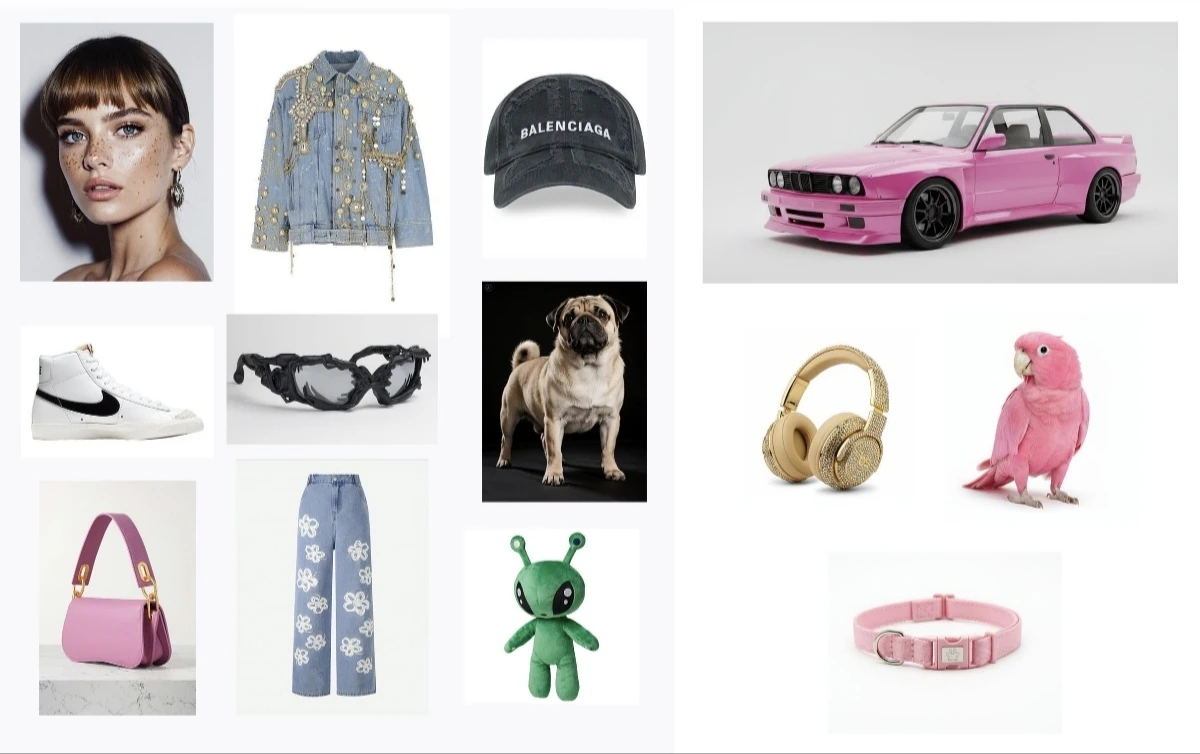

Composition multi-image

Générez une nouvelle image à partir de plusieurs images d’entrée. CometAPI prend en charge deux approches :Méthode 1 : Image de collage unique

Combinez plusieurs images source en un seul collage, puis décrivez le résultat souhaité.

Méthode 2 : Plusieurs images séparées (jusqu’à 14)

Transmettez directement plusieurs images. Les modèles Gemini 3 prennent en charge jusqu’à 14 images de référence (objets + personnages) :

Génération d’images 4K

Spécifiezimage_config avec aspect_ratio et image_size pour une sortie en haute résolution :

Édition d’images multi-tour (Chat)

Utilisez la fonctionnalité de chat du SDK pour affiner des images de manière itérative :Conseils

Optimisation du Prompt

Optimisation du Prompt

Spécifiez des mots-clés de style (par ex. « cyberpunk, grain de film, faible contraste »), le format d’image, le sujet, l’arrière-plan, l’éclairage et le niveau de détail.

Format Base64

Format Base64

Lorsque vous utilisez du HTTP brut, n’incluez pas le préfixe

data:image/png;base64, — utilisez uniquement la chaîne Base64 brute. Le SDK Python gère cela automatiquement avec les objets PIL.Image.Forcer la sortie d’image

Forcer la sortie d’image

Définissez

"responseModalities" sur ["IMAGE"] uniquement pour garantir une sortie image sans texte.