- Generowanie tekst-na-obraz

- Edycję obraz-na-obraz

- Kompozycję wielu obrazów

- Zapisywanie wygenerowanych obrazów

- Base URL:

https://api.cometapi.com - Zainstaluj SDK:

pip install google-genai(Python) lubnpm install @google/genai(Node.js)

Konfiguracja

Zainicjalizuj klienta z bazowym adresem URL CometAPI:Generowanie tekstu na obraz

Wygeneruj obraz na podstawie tekstowego promptu i zapisz go do pliku.candidates[0].content.parts, które mogą zawierać części tekstowe i/lub części obrazu:

Generowanie obrazu na podstawie obrazu

Prześlij obraz wejściowy i przekształć go za pomocą Promptu tekstowego.- Python SDK akceptuje obiekty

PIL.Imagebezpośrednio — nie jest potrzebne ręczne kodowanie Base64. - Nie dołączaj prefiksu

data:image/jpeg;base64,podczas przekazywania surowych ciągów Base64.

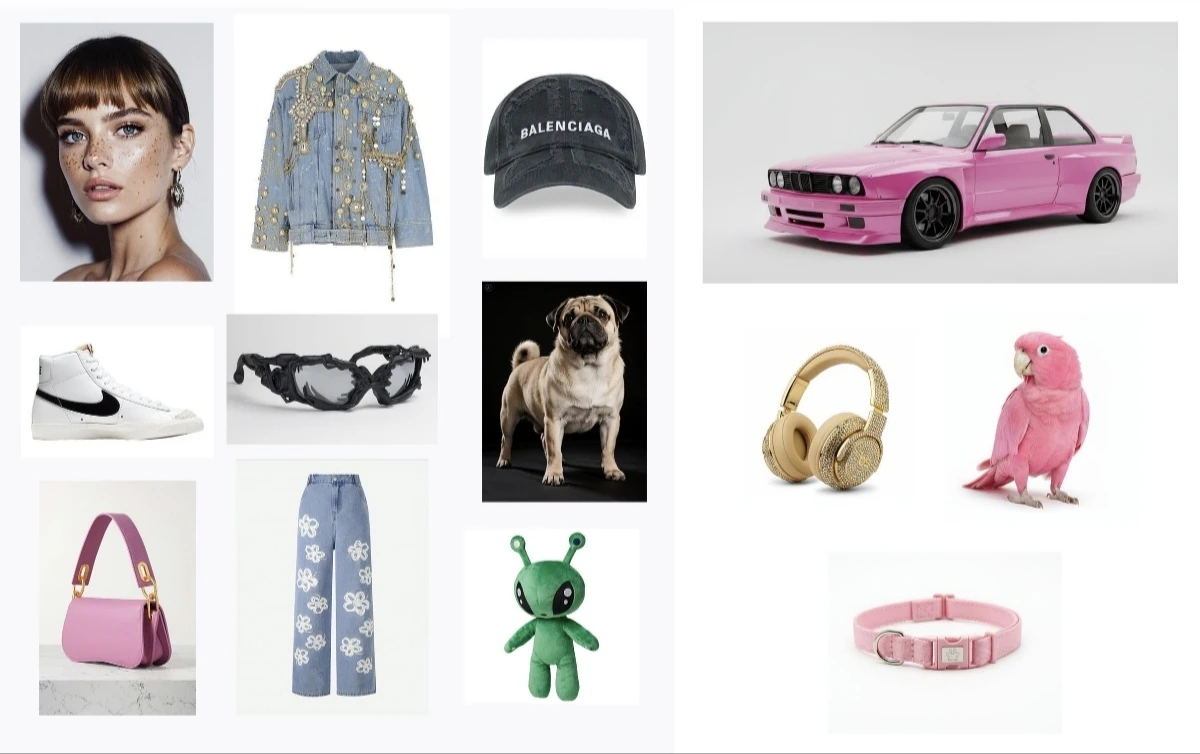

Kompozycja z wielu obrazów

Wygeneruj nowy obraz z wielu obrazów wejściowych. CometAPI obsługuje dwa podejścia:Metoda 1: Pojedynczy obraz-kolaż

Połącz wiele obrazów źródłowych w jeden kolaż, a następnie opisz oczekiwany wynik.

Metoda 2: Wiele oddzielnych obrazów (do 14)

Przekaż wiele obrazów bezpośrednio. Modele Gemini 3 obsługują do 14 obrazów referencyjnych (obiekty + postacie):

Generowanie obrazów 4K

Określimage_config z aspect_ratio i image_size, aby uzyskać wynik w wysokiej rozdzielczości:

Edycja obrazów wieloetapowa (Chat)

Użyj funkcji chat w SDK, aby iteracyjnie dopracowywać obrazy:Wskazówki

Prompt Optimization

Prompt Optimization

Określ słowa kluczowe stylu (np. “cyberpunk, film grain, low contrast”), proporcje obrazu, temat, tło, oświetlenie i poziom szczegółowości.

Base64 Format

Base64 Format

Podczas korzystania z surowego HTTP nie dołączaj prefiksu

data:image/png;base64, — używaj tylko surowego ciągu Base64. Python SDK obsługuje to automatycznie za pomocą obiektów PIL.Image.Force Image Output

Force Image Output

Ustaw

"responseModalities" wyłącznie na ["IMAGE"], aby zagwarantować wyjście obrazu bez tekstu.